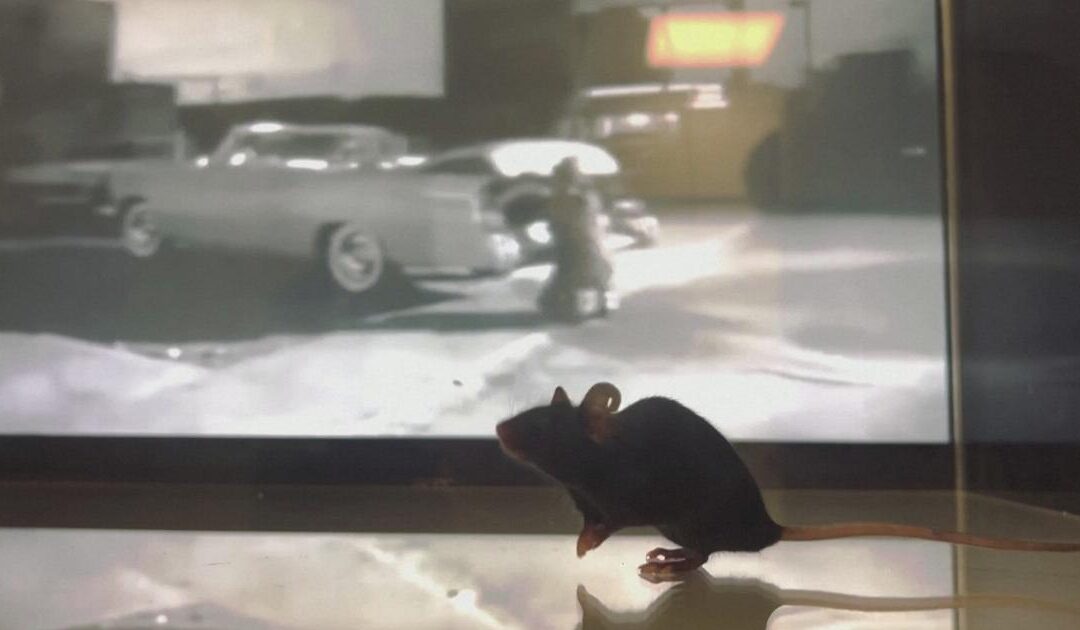

Si chiama Cebra il nuovo algoritmo che apre la strada a futuristiche interfacce cervello-macchina capaci di ricostruire dettagliatamente ciò che una persona sta guardando semplicemente sulla base dei segnali elettrici rilevati nel suo cervello. I primi esperimenti, condotti al Politecnico di Losanna, hanno permesso di ricostruire quali sequenze di un film in bianco e nero stesse guardando un topo, riproducendole in maniera quasi del tutto simile all’originale. I risultati sono pubblicati sulla rivista Nature.

Utilizzando i segnali prodotti dalla corteccia visiva dei topi, l’algoritmo Cebra ha permesso di addestrare un modello di apprendimento profondo (deep learning) che decodifica ciò che l’animale sta guardando. Se dieci anni fa era possibile decodificare forme molto semplici, ora diventa possibile decodificare intere sequenze di film partendo dai segnali sparati dai neuroni in risposta a specifiche proprietà del video (come gli oggetti rappresentati, i colori e perfino le emozioni che suscita). Lo studio dimostra inoltre che Cebra può essere usato per prevedere i movimenti di un arto nei primati e per ricostruire la posizione di un ratto che si muove liberamente in una piccola arena.

“L’obiettivo di Cebra è scoprire la struttura nei sistemi complessi e, dato che il cervello è la struttura più compless adel nostro universo, è lo spazio di prova migliore”, afferma la neuroscienziata Mackenzie Mathis che ha coordinato lo studio.

“Può anche darci un’idea di come il cervello elabora le informazioni e potrebbe diventare una piattaforma per scoprire nuovi principi nelle neuroscienze combinando dati tra diversi animali e persino specie. Questo algoritmo non è limitato alla ricerca neuroscientifica, in quanto può essere applicato a molti set di dati che coinvolgono informazioni temporali o combinate, inclusi dati sul comportamento animale e sull’espressione genica. Pertanto, le potenziali applicazioni cliniche sono entusiasmanti”.