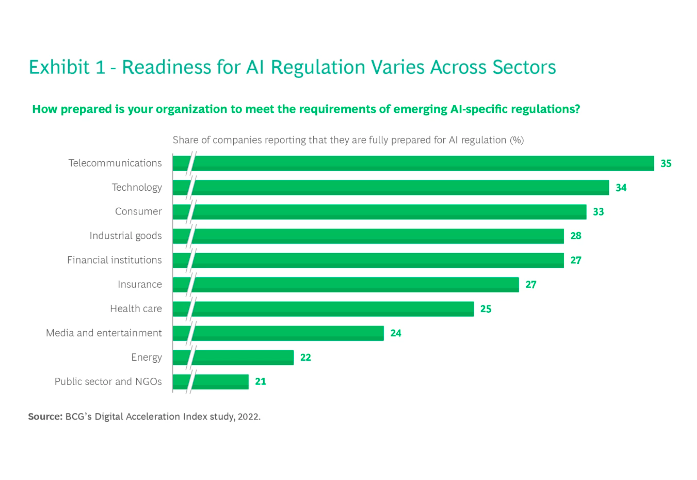

L’Italia si dimostra già preparata in vista dell’arrivo di un quadro normativo specifico sull’intelligenza artificiale: il 49% di dirigenti del Belpaese si dicono infatti convinti della necessità di una regolamentazione per l’uso dell’AI, contro la media europea del 35%, mentre il 34% afferma inoltre di avere già un Chief AI operativo all’interno della propria organizzazione. Il tutto mentre, a livello globale, solo il 28% dei dirigenti afferma che la propria organizzazione è pienamente preparata ad affrontare le nuove normative in questo ambito.

Sono alcune delle evidenze che emergono dallo studio di Bcg “Five Ways to Prepare for AI Regulation”, indagine globale e annuale condotta su 2.700 dirigenti nel mondo ormai alla sesta edizione, secondo la quale il modo migliore che le aziende hanno per affrontare le regolamentazioni è implementare un programma di Intelligenza artificiale responsabile (RAI), fondato cioè su principi volti a garantire la responsabilità, la trasparenza, la privacy e la sicurezza, nonché l’equità e l’inclusione nel modo in cui si sviluppano e si utilizzano gli algoritmi.

AI Act europeo: l’apripista

L’AI Act europeo, anche se in fase di proposta, è l’esempio del primo regolamento che istituisce un quadro giuridico volto a regolare lo sviluppo, la commercializzazione e l’uso dell’intelligenza artificiale in conformità con i valori e i diritti costituzionali dell’Ue. La proposta di regolamentazione stabilisce delle regole per l’immissione sul mercato e per l’uso dei sistemi di intelligenza artificiale, vieta pratiche come la sorveglianza biometrica di massa e la valutazione del credito basata sul social scoring e propone sanzioni pecuniarie per un massimo del 6% del fatturato alle aziende che attuano pratiche vietate. L’Italia, nello specifico, ha lanciato il “Programma strategico per l’intelligenza artificiale 2022-2024”, che delinea 24 politiche per accelerare l’innovazione e le potenzialità dell’AI nel tessuto economico e sociale del Paese.

Le 4 fasi in cui l’AI migliora la gestione degli ordini. Scoprile nella guida inedita!

Amministrazione/Finanza/Controllo

“L’intelligenza artificiale responsabile è valutata da molti esclusivamente in ottica di compliance, mentre in realtà rappresenta un insieme di fattori abilitanti verso l’innovazione”, spiega Enzo Barba, partner di Bcg X, divisione della società di consulenza specializzata sull’AI. “Le iniziative Rai possono infatti rappresentare il quadro di riferimento sia per chi crea strumenti di intelligenza artificiale che per chi li utilizza, aiutando entrambe le parti a confrontarsi positivamente con la regolamentazione. Questo aspetto è rilevante soprattutto per le aziende italiane che si trovano ad operare in un contesto regolamentare molto attento alle dinamiche di sviluppo delle nuove tecnologie e del loro impatto sulla privacy degli utenti – basti pensare al blocco di ChatGpt da parte del Garante della Privacy: anche se l’accesso è stato riattivato a fine aprile, questa iniziativa potrebbe fare da apripista per i lavori di una task force europea sul tema. Definire un quadro comune e condiviso potrebbe quindi richiedere del tempo, ma le aziende possono contribuire a plasmare il panorama normativo piuttosto che esserne sopraffatte, se si attivano nell’immediato.”

In Italia Energy, Finance e Tech i settori più preparati

Per le aziende è fondamentale cogliere velocemente il momento per plasmare il panorama di riferimento, ma…